借助硅基流动,免费实现deepseek、智谱清言、通义千问 AI翻译的教程

1. 登陆 https://account.siliconflow.cn/zh/login

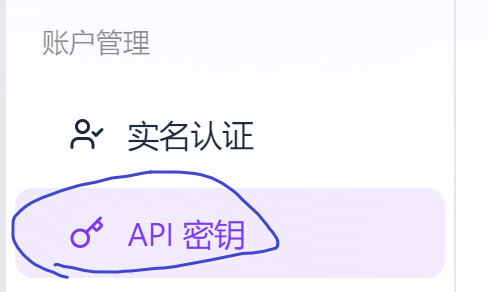

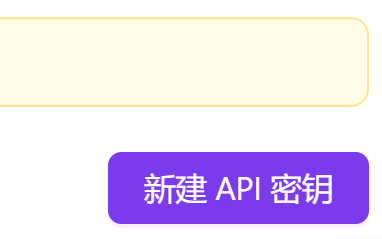

2. 进入之后,点击左侧 API密钥,新建api密钥,申请 api。复制新建密钥 一会要用

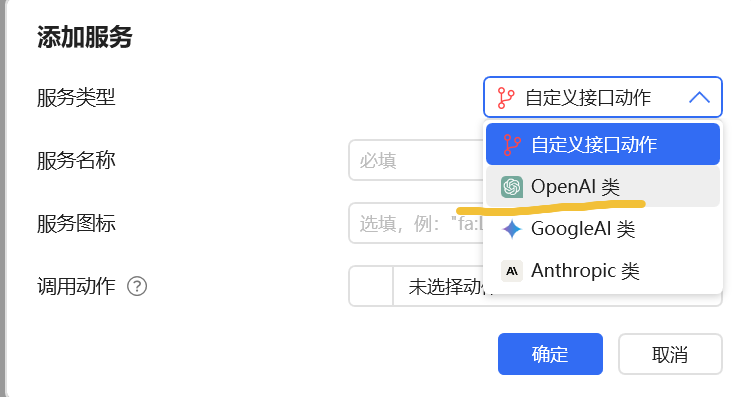

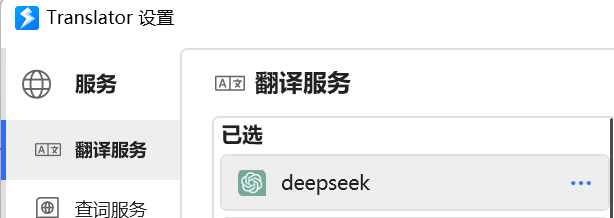

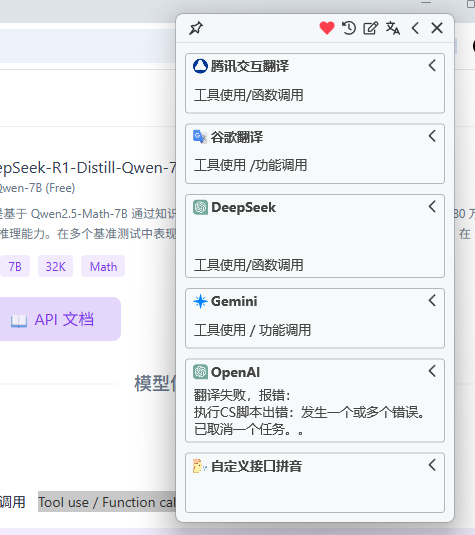

3. 点击 Translator图标,右键 设置,点击右边 翻译服务,点击 添加,选择 openAI类。

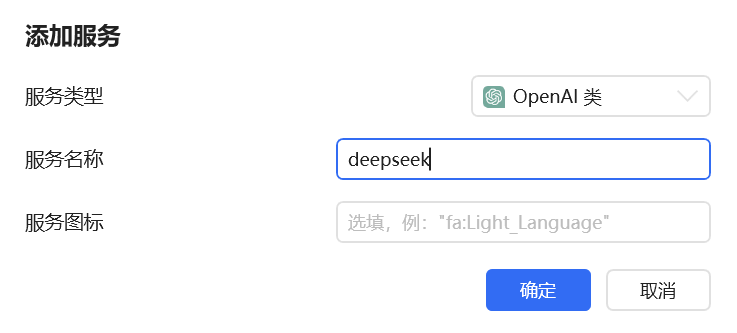

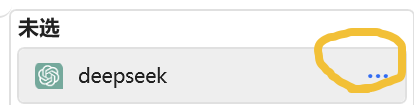

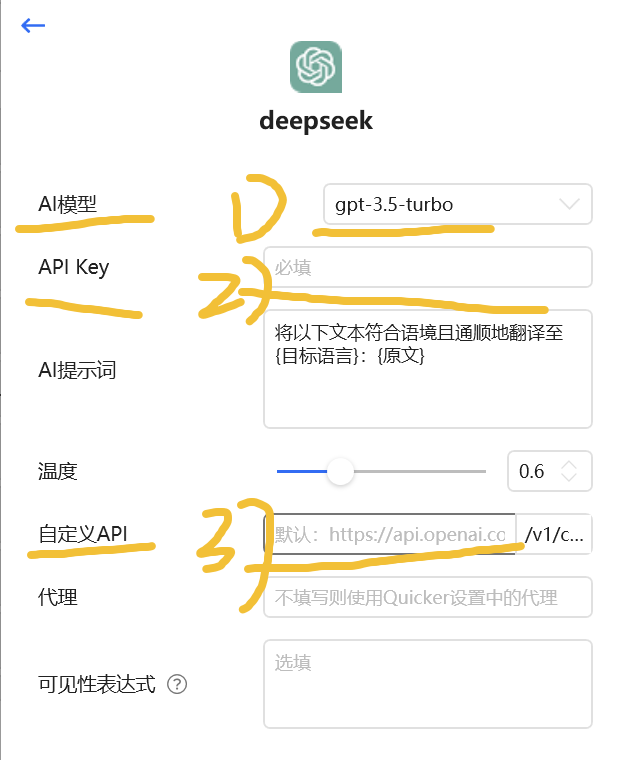

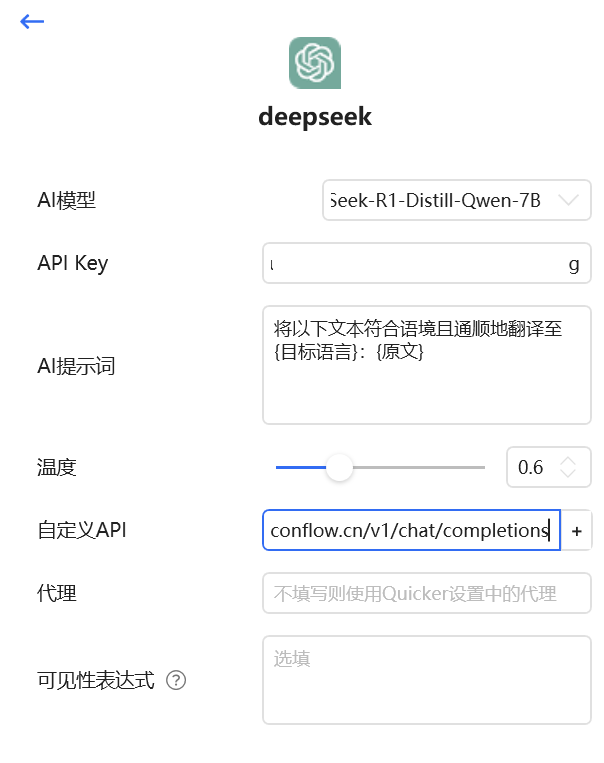

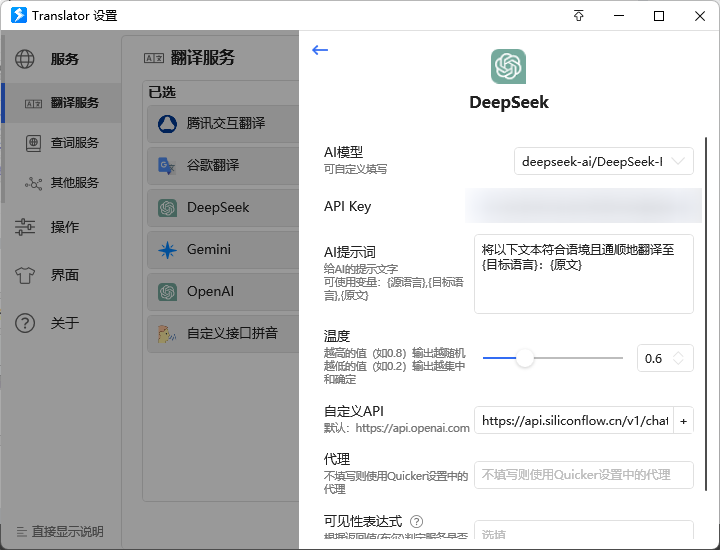

4. 在 服务名称 填写 deepseek,注意 服务名称 可以随便取。点击出现的 未选 deepseek 旁边的…,出现下面的截图 先不要关闭界面

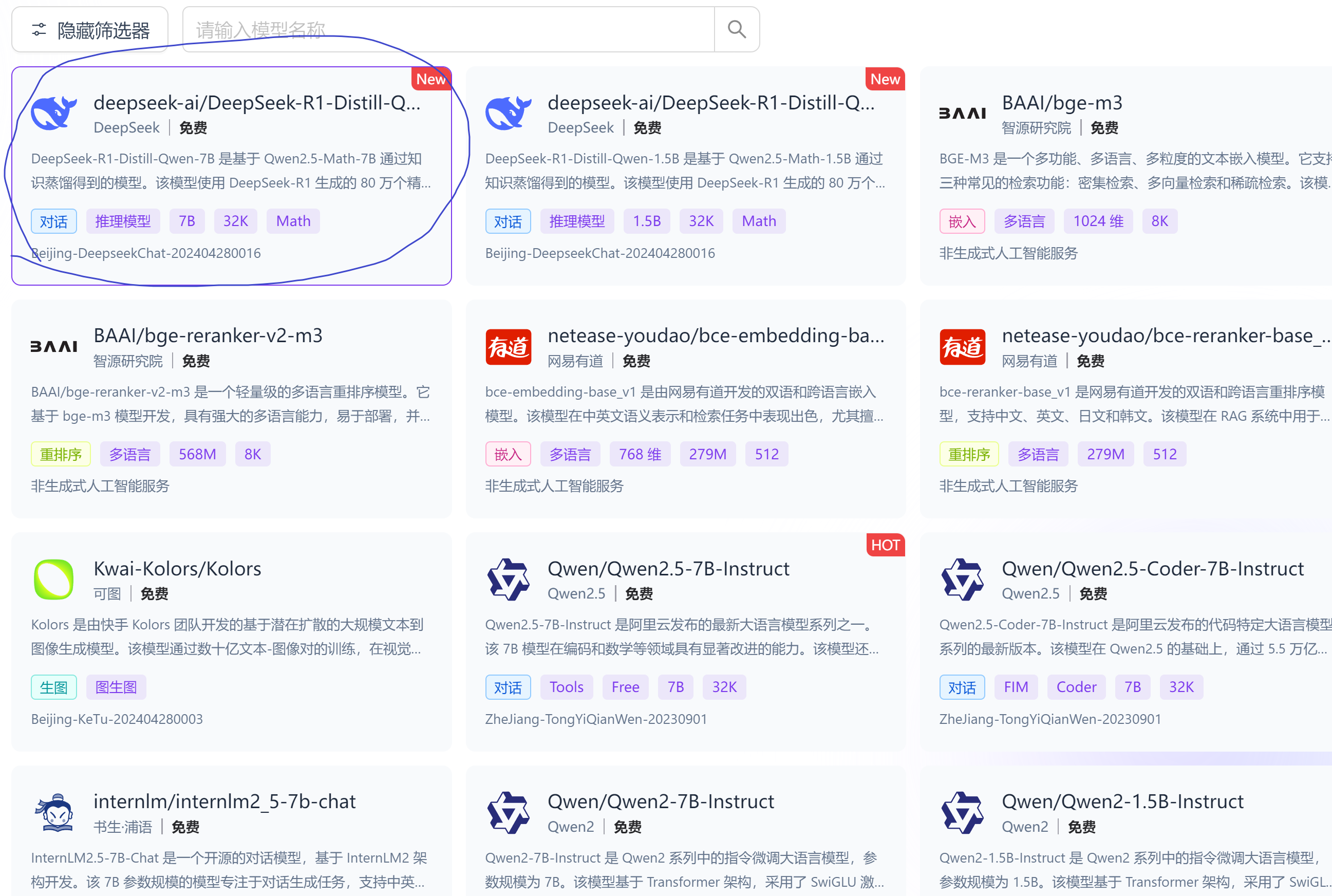

5. 去硅基流动网址 https://cloud.siliconflow.cn/models,点击模型广场,选择只看免费。点击deepseek -7B模型。

6. 出现 如下截图,复制模型名称1),填入4步骤的1)处。把2步骤新建的密钥 复制 填入4步骤的2)处。

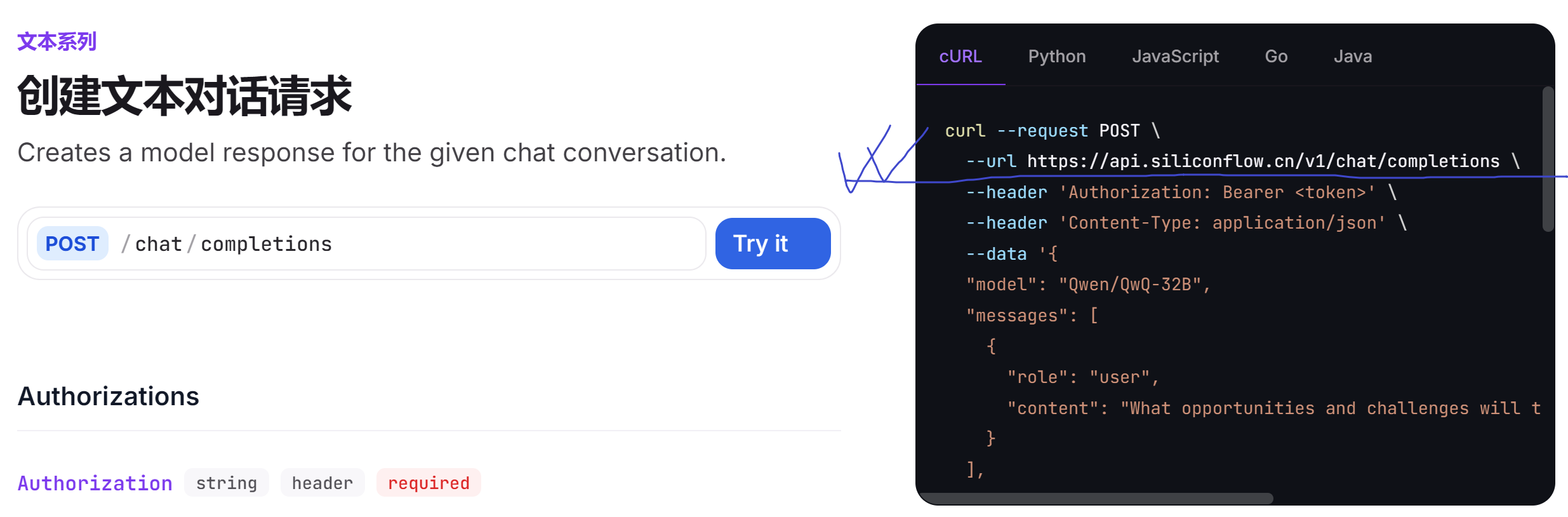

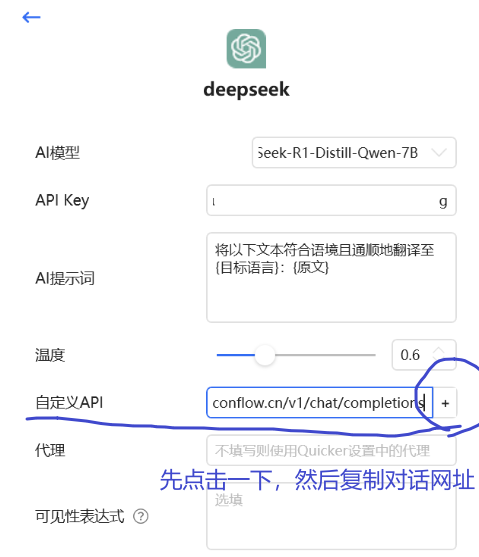

7. 点击6图的API文档。把出现界面的url https://api.siliconflow.cn/v1/chat/completions 复制 。点击步骤4中3)旁边的/v1,然后把https://api.siliconflow.cn/v1/chat/completion粘贴即可

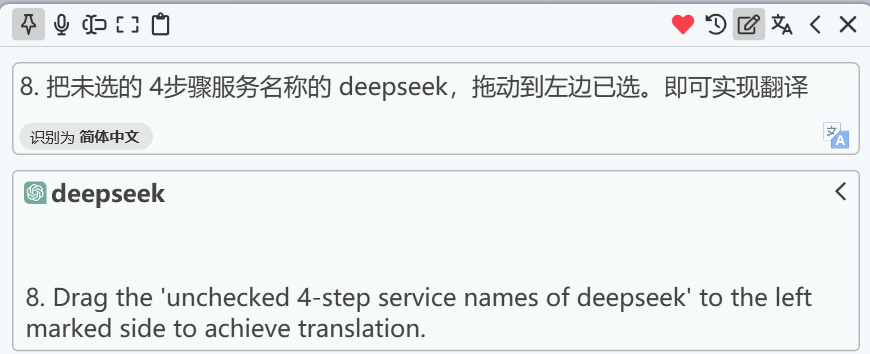

8. 把未选的 4步骤服务名称的 deepseek,拖动到左边 已选。即可实现翻译

经验证不同的deepseek模型结果翻译不完全一样,一些模型的反应有些慢。可以添加多个deepseek模型、智谱清言模型、千问模型实现多模型AI翻译。

感谢quicker、zryan提供了那么好的动作,vv12138、little_ant、车站里的守望者等大神的不断开发完善,及大家宝贵的交流经验。

回复内容

同类型感觉参数大些的好一些。以下这三个还不错

deepseek-ai/DeepSeek-R1-Distill-Qwen-7B

Qwen/Qwen2.5-7B-Instruct

THUDM/glm-4-9b-chat

用起来发现deepseek的模型7B的翻译速度不如1.5B的速度快。

deepseek-ai/DeepSeek-R1-Distill-Qwen-1.5B

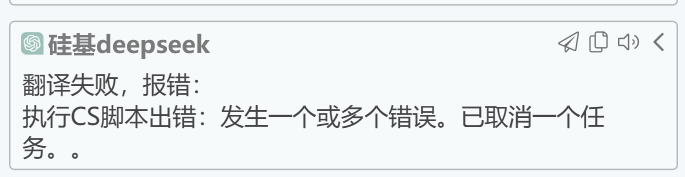

你用的是哪个模型呀。是这个吗 deepseek-ai/DeepSeek-R1-Distill-Qwen-7B。要对话型的模型才行

是的,我是按照教程来的

是不是这里没点击的原因,把原始的v1 点击一下去掉

是不是这里没点击的原因,把原始的v1 点击一下去掉

京公网安备 11010502053266号

京公网安备 11010502053266号