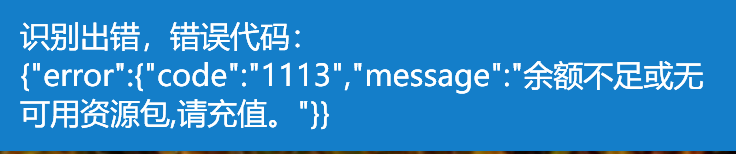

大佬,有空帮忙看下,智谱GLM OCR是免费的不,为啥会提示余额不足?

使用问题

·

119 次浏览

回复内容

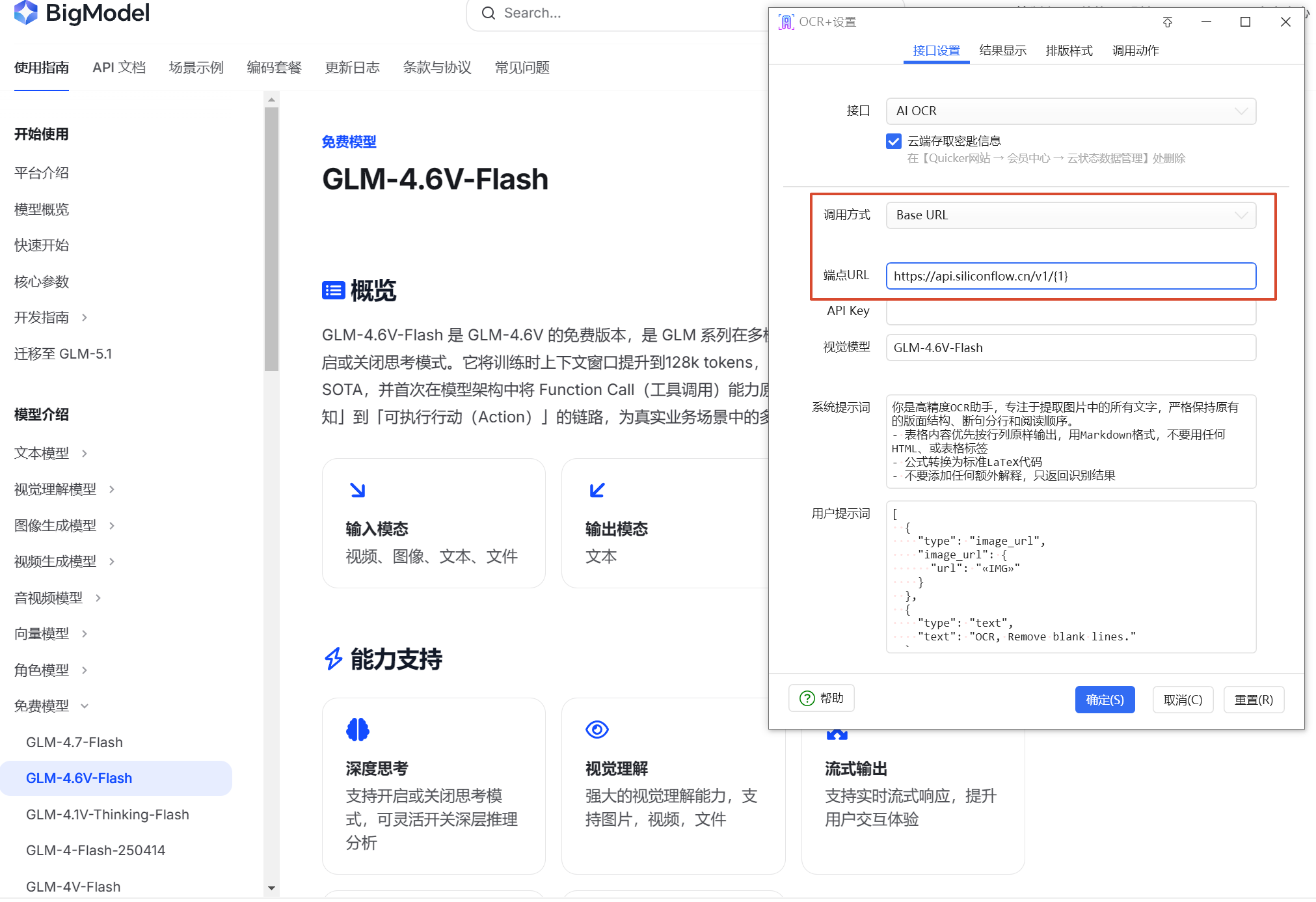

1、大佬,这个动作很方便,但是我感觉ai-ocr接口,应该是要优化下,调用方式选Base URL和http模式都一样很慢,相同的模型,ocr识别耗时比其他动作慢很多。

2、调试运行,在ai调用或者http请求这两个步骤耗时耗时:7461ms、耗时:61047ms

3、例如跟这款万能识别动作相比,相同的ai模型,就慢很多https://getquicker.net/Sharedaction?code=9062589a-dba2-425f-860c-08dcf8c7ad5e

CHL~

最后更新于 26天6小时前

京公网安备 11010502053266号

京公网安备 11010502053266号

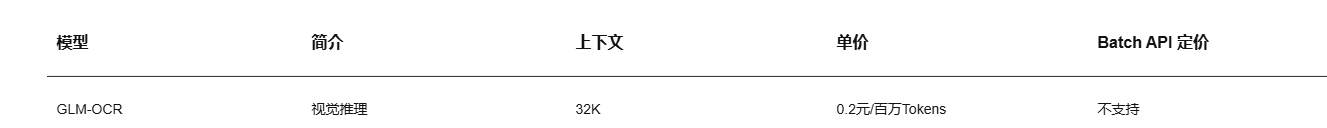

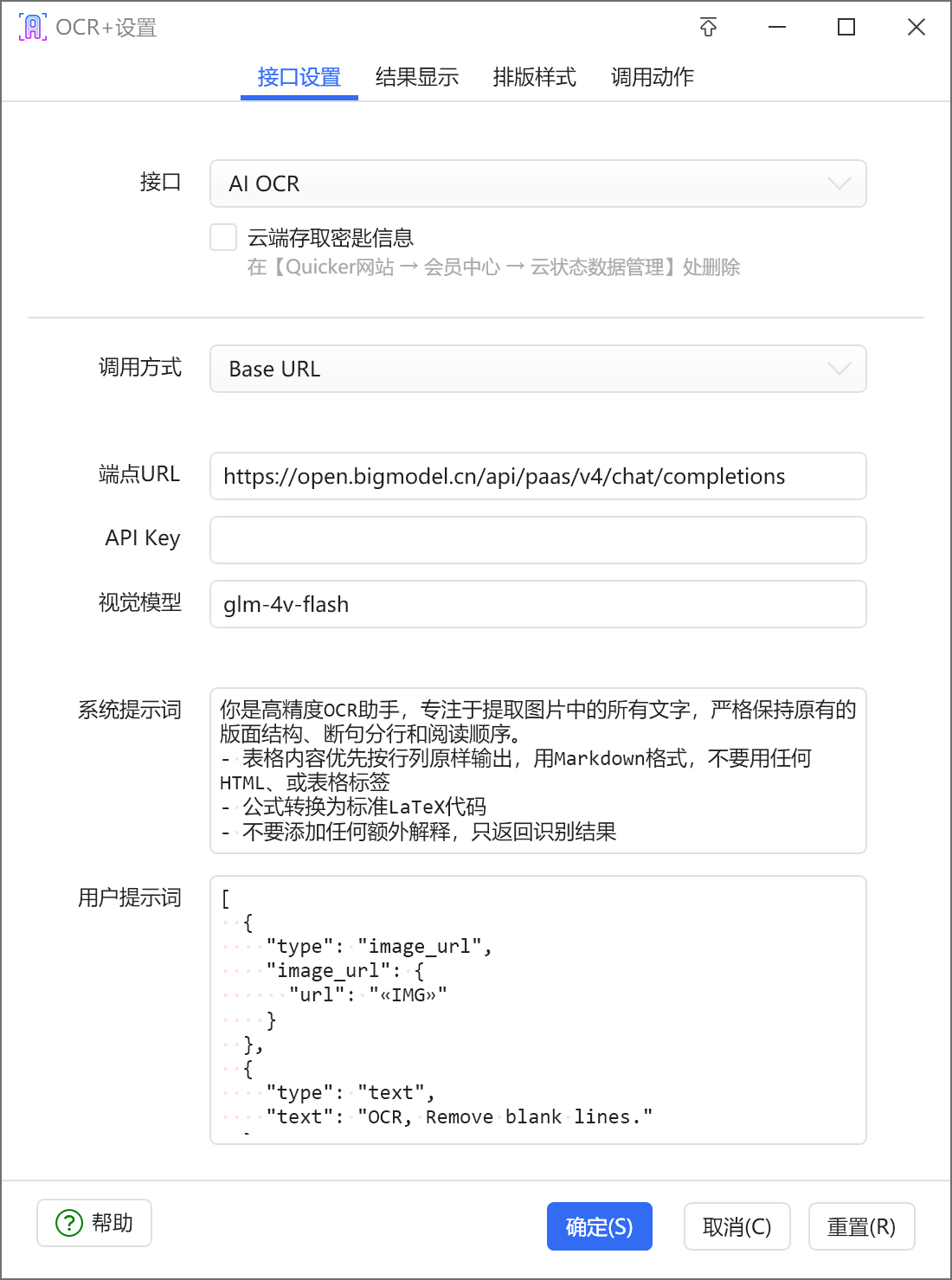

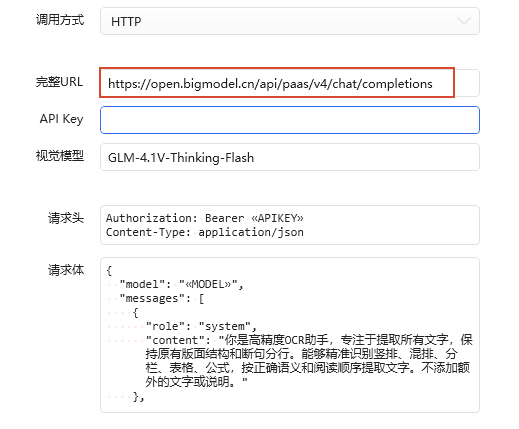

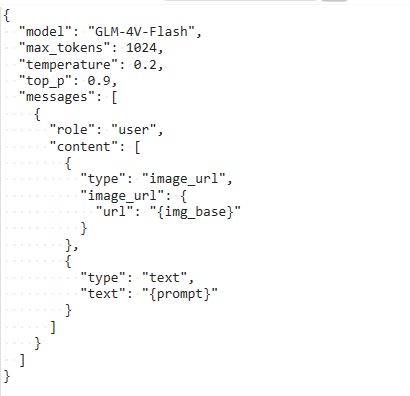

如果想用glm-ocr,这么填写可以么?问的ai,端点url填的智谱平台

glm-ocr的话,直接选这个,填KEY